Le riflessioni di Murray Shanahan, professore di robotica cognitiva e consulente del film “Ex machina”, nel libro “La rivolta delle macchine”

“Se l’intelletto diventasse non solo produttore, ma anche prodotto della tecnologia, potrebbe allora generarsi un circolo vizioso imprevedibile e dalle conseguenze potenzialmente pericolose”, scrive Murray Shanahan, professore di robotica cognitiva dell’Imperial College di Londra. Il suo libro, La rivolta delle macchine (Luiss University Press) è incentrato su una possibilità da sempre dibattuta nella storia della tecnologia e spesso ritenuta in bilico tra la fantascienza e la realtà: quella della “singolarità tecnologica”, definita come un momento di “cambiamento talmente radicale da far terminare le cose umane così come le comprendiamo oggi” per via dell’avanzamento tecnologico progressivo nell’ambito dell’intelligenza artificiale e delle neurotecnologie.

Si tratta, insomma, del topos della rivolta delle macchine che, presa finalmente coscienza di loro stessi, sfuggono al controllo degli umani e del potere esercitato da questi ultimi su di essa.

Una delle strade per lo sviluppo dell’intelligenza artificiale è quella dell’emulazione del cervello umano, un processo composto dalla mappatura, dalla simulazione e dall’incarnazione della mente umana in un contesto tecnologico e potenzialmente umanoide che replichi gli 80 miliardi di neuroni connessi “copiandoli in forma di elementi elettronici in chip di silicio”, come ha sintetizzato Sidney Perkowitz sulla Los Angeles Review of Books qualche anno fa recensendo l’edizione inglese del libro di Shanahan.

I limiti per lo sviluppo di questo processo sono puramente tecnici e dovuti ai limiti di capacità di calcolo della tecnologia attualmente disponibile, superabili col tempo. Per Shanahan, la mappatura completa del cervello di un topo (a quel punto “avremo fatto uscire il genio dalla lampada”, scrive l’autore) porterebbe piuttosto velocemente alla creazione di un’intelligenza artificiale di livello umano e, di conseguenza, a una super-intelligenza generata dal suo autosviluppo e dall’eliminazione degli umani dal loro ruolo centrale di creatori.

Con conseguenze imprevedibili. Per Murray Shanahan, questi non sono più discorsi da libro o film di fantascienza, ma scenari possibili che occorrerebbe tenere in considerazione già da ora. Murray, che nel 2014 ha fatto da consulente scientifico per il film Ex-Machina di Alex Garland, quello dell’emulazione del cervello umano è però solo uno dei possibili scenari di sviluppo dell’intelligenza artificiale.

Tutte le tecnologie di intelligenza artificiale incorporee già attualmente in uso, come il machine learning, gli assistenti personali delle grandi aziende tech e l’applicazione del calcolo dei big data, concorrono a loro volta al possibile sviluppo di una super-intelligenza “di tipo sbagliato” destinata potenzialmente a prendere il controllo e dai tratti attualmente imprevedibili. Per Shanahan è fondamentale avere coscienza del potenziale della tecnologia attuale e rendersi conto, ora che è tutto sommato ancora in nuce, che i suoi sbocchi possibili potrebbero ancora non essere stati nemmeno abbozzati.

Shanahan è comunque chiaro sull’allontanare facili allarmismi: “i piccoli frammenti di tecnologia IA specializzata si stanno facendo sempre più spazio nelle applicazioni quotidiane, ma la tecnologia IA di oggi è molto lontana dall’intelligenza artificiale forte di livello umano, in possesso di senso comune e creatività”.

Quella possibilità, per quanto da sottrarre alla fantascienza, è quindi comunque ancora parecchio distante e il libro di Shanahan è scettico, ad esempio, nei confronti della nota previsione di Ray Kurzweil che aveva previsto l’approdo della super-intelligenza già per il 2045. Quello che si vede in atto oggi è piuttosto l’avanzare di processi che potrebbero portarvi: la questione è quindi decidere che “mondo lasceremo alle generazioni future” e smettere di credere che un’ipotesi estremamente distopica non sia per nulla possibile.

Un punto cruciale a questa comprensione è anche stabilire i livello di dipendenza tecnologica cui vogliamo affidarci, perché l’intelligenza artificiale andrà in ogni caso ad aumentarla. Shanahan rimane però nel mezzo del dibattito tra pessimisti e ottimisti della tecnologia dell’informazione, sottolineandone sia gli immensi pregi che i costi sociali, spesso nascosti ma pesanti. Per il futuro, scrive Shanahan, la speranza è trovare un modo di massimizzarne i benefici, riducendone i costi, qualcosa che forse non ci è riuscito al meglio nei confronti della tecnologia sviluppata negli ultimi due decenni. Il rischio, altrimenti, è che una seconda ondata di tecnologia di intelligenza artificiale porti a conseguenze molto gravi: “se commetteremo uno scivolone, non riuscendo a porre in atto le giuste misure di sicurezza prima che si verifichi un’esplosione di intelligenza, allora come specie non sopravviveremo”, ammonisce Shanahan.

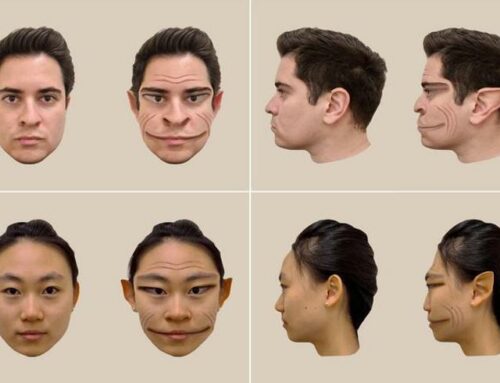

Quello che occorre, per evitare gli scenari più gravi, parte anche dall’eleminare la ricerca dell’antropomorfismo nel riferirci all’intelligenza artificiale: quella a immagine e somiglianza di noi umani sarà solo una fetta del suo futuro, mentre molte altre forme potrebbero essere maggioritarie e più potenti anche perché i loro comportamenti “non saranno guidati da emozioni simili a quelle umane”. Il futuro dell’umano potrebbe essere connesso alla nostra capacità di “limitare i poteri dell’IA e calibrarne la funzione-ricompensa”.

FONTE