Un team di ricercatori della University of Massachusetts Amherst ha sviluppato un metodo che si basa su algoritmi chiamati Seldonian in grado di insegnare all’Ai ad essere eticamente giusta e corretta

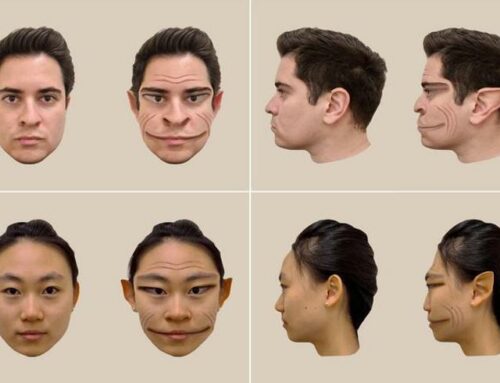

Le stiamo insegnando qualsiasi cosa, dal fare diagnosi a risolvere il cubo di Rubik. Ma ora all’intelligenza artificiale (Ai), a quanto pare, si può insegnare anche ad essere equa e giusta, un requisito, quello dell’etica, fondamentale soprattutto quando si parla di criminalità, pregiudizi o differenze di genere. Basti pensare che, come raccontava Science circa un mese fa, un algoritmo comunemente utilizzato negli ospedali statunitensi per distribuire l’assistenza sanitaria ai pazienti ha sistematicamente discriminato le persone di colore. In altre parole, l’algoritmo aveva meno probabilità di indirizzare le persone di colore rispetto ai bianchi che erano ugualmente malati per programmi mirati a migliorare l’assistenza a pazienti con complesse esigenze mediche.

A porre nuovamente l’accento sul problema dell’etica nel machine learning in uno studio appena pubblicato su Science sono stati i ricercatori della University of Massachusetts Amherst che hanno descritto un nuovo metodo per prevenire ciò che il team di ricerca chiama “comportamento indesiderato” nell’Ai.

Garantire un comportamento sicuro ed equo delle Ai, spiegano i ricercatori, è ancora oggi un problema. “Quando qualcuno applica un algoritmo di machine learning, è difficile controllarne il comportamento”, spiega Philip Thomas, tra gli autori dello studio. “Ma gli algoritmi di apprendimento automatico incidono sempre più sulla nostra vita ed è quindi di fondamentale importanza garantirne l’equità ed evitare danni”. In recente studio, continua l’esperto, sono state elencate 21 diverse definizioni di equità nell’apprendimento automatico. “È importante consentire all’utente di selezionare la definizione appropriata per l’applicazione prevista. L’interfaccia fornita con un algoritmo Seldonian consente all’utente di fare proprio questo: definire cosa significa “comportamento indesiderato” per la propria applicazione”.

Il framework appena sviluppato si basa sugli algoritmi chiamati appunto Seldonian, che prendono il nome dal protagonista Hari Seldon della famosa saga di romanzi di fantascienza di Isaac Asimov, il Ciclo delle Fondazioni. Tra le sperimentazioni, il team ha sviluppato proprio un algoritmo Seldonian per prevedere le medie dei voti di 43mila studenti, dimostrandosi in grado di evitare diversi tipi di pregiudizi di genere.

Questi algoritmi non si limitano a garantire un comportamento corretto, spiegano i ricercatori, ma è possibile controllare qualsiasi tipo di comportamento, ad esempio funzioni di sicurezza complesse nei sistemi medici. Ad esempio per controllare una pompa per l’insulina automatizzata e per prevedere in modo sicuro le dosi per una persona in base ai livelli ematici di glucosio.“Se uso un algoritmo Seldonian per trattare il diabete, posso specificare che un “comportamento indesiderato” significa la presenza di livelli di glicemia pericolosamente bassi o ipoglicemia”, spiega l’autore. “Posso, quindi, dire all’Ai: mentre stai cercando di migliorare il controller nella pompa per insulina, non apportare modifiche che aumenterebbero la frequenza dell’ipoglicemia. La maggior parte degli algoritmi disponibili non ti dà un modo per mettere questo tipo di vincolo sul comportamento”.

I ricercatori sottolineano che questi esperimenti servono solo come prova di cosa sono capaci gli algoritmi Seldonian e che il framework può essere usato da altri scienziati come guida per costruire futuri sistemi di intelligenza artificiale. “Riteniamo che ci sia un enorme margine di miglioramento in questo settore”, conclude Thomas. “Anche con i nostri algoritmi abbiamo ottenuto risultati impressionanti. Speriamo che gli esperti del machine learning continuino a sviluppare algoritmi nuovi e più sofisticati servendosi il nostro framework, che può essere utilizzato in modo responsabile anche per le applicazioni in cui si considerava l’apprendimento automatico rischioso”.

FONTE

A porre nuovamente l’accento sul problema dell’etica nel machine learning in uno studio appena pubblicato su Science sono stati i ricercatori della University of Massachusetts Amherst che hanno descritto un nuovo metodo per prevenire ciò che il team di ricerca chiama “comportamento indesiderato” nell’Ai.

Garantire un comportamento sicuro ed equo delle Ai, spiegano i ricercatori, è ancora oggi un problema. “Quando qualcuno applica un algoritmo di machine learning, è difficile controllarne il comportamento”, spiega Philip Thomas, tra gli autori dello studio. “Ma gli algoritmi di apprendimento automatico incidono sempre più sulla nostra vita ed è quindi di fondamentale importanza garantirne l’equità ed evitare danni”. In recente studio, continua l’esperto, sono state elencate 21 diverse definizioni di equità nell’apprendimento automatico. “È importante consentire all’utente di selezionare la definizione appropriata per l’applicazione prevista. L’interfaccia fornita con un algoritmo Seldonian consente all’utente di fare proprio questo: definire cosa significa “comportamento indesiderato” per la propria applicazione”.

Il framework appena sviluppato si basa sugli algoritmi chiamati appunto Seldonian, che prendono il nome dal protagonista Hari Seldon della famosa saga di romanzi di fantascienza di Isaac Asimov, il Ciclo delle Fondazioni. Tra le sperimentazioni, il team ha sviluppato proprio un algoritmo Seldonian per prevedere le medie dei voti di 43mila studenti, dimostrandosi in grado di evitare diversi tipi di pregiudizi di genere.

Questi algoritmi non si limitano a garantire un comportamento corretto, spiegano i ricercatori, ma è possibile controllare qualsiasi tipo di comportamento, ad esempio funzioni di sicurezza complesse nei sistemi medici. Ad esempio per controllare una pompa per l’insulina automatizzata e per prevedere in modo sicuro le dosi per una persona in base ai livelli ematici di glucosio.“Se uso un algoritmo Seldonian per trattare il diabete, posso specificare che un “comportamento indesiderato” significa la presenza di livelli di glicemia pericolosamente bassi o ipoglicemia”, spiega l’autore. “Posso, quindi, dire all’Ai: mentre stai cercando di migliorare il controller nella pompa per insulina, non apportare modifiche che aumenterebbero la frequenza dell’ipoglicemia. La maggior parte degli algoritmi disponibili non ti dà un modo per mettere questo tipo di vincolo sul comportamento”.

I ricercatori sottolineano che questi esperimenti servono solo come prova di cosa sono capaci gli algoritmi Seldonian e che il framework può essere usato da altri scienziati come guida per costruire futuri sistemi di intelligenza artificiale. “Riteniamo che ci sia un enorme margine di miglioramento in questo settore”, conclude Thomas. “Anche con i nostri algoritmi abbiamo ottenuto risultati impressionanti. Speriamo che gli esperti del machine learning continuino a sviluppare algoritmi nuovi e più sofisticati servendosi il nostro framework, che può essere utilizzato in modo responsabile anche per le applicazioni in cui si considerava l’apprendimento automatico rischioso”.

FONTE

1.009